Ollama + OpenClaw 快速上手|Windows 篇

Windows 專用教學:透過 WSL + Node 22,用 Ollama 免費雲端額度讓 OpenClaw 開口說話,完全不用設定 API Key。

Windows 用戶必看:OpenClaw 在 Windows 上需要透過 WSL(Windows Subsystem for Linux)運行,這是微軟官方支援的方式,穩定性遠比原生 Windows 環境好。整個流程約 15 分鐘,照著走就沒問題。

準備工作

- Windows 10(版本 2004 以上)或 Windows 11

- 網路連線

- 不需要任何 API Key

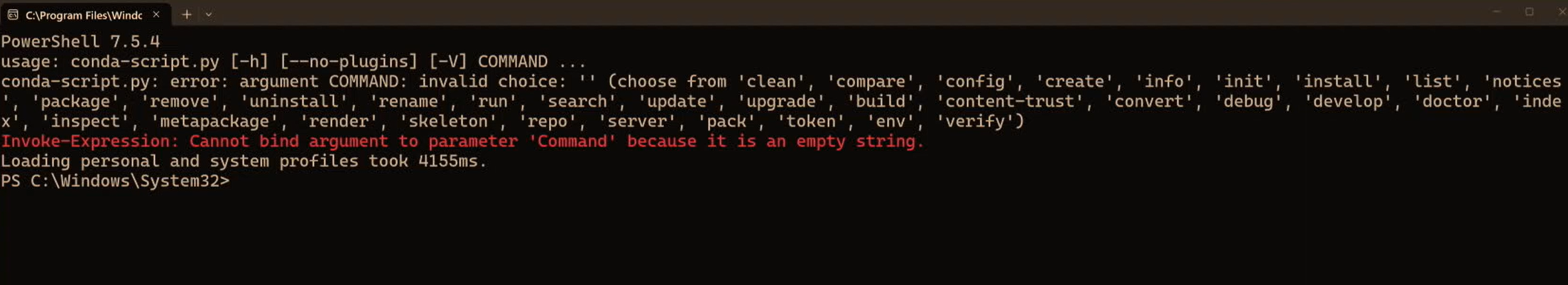

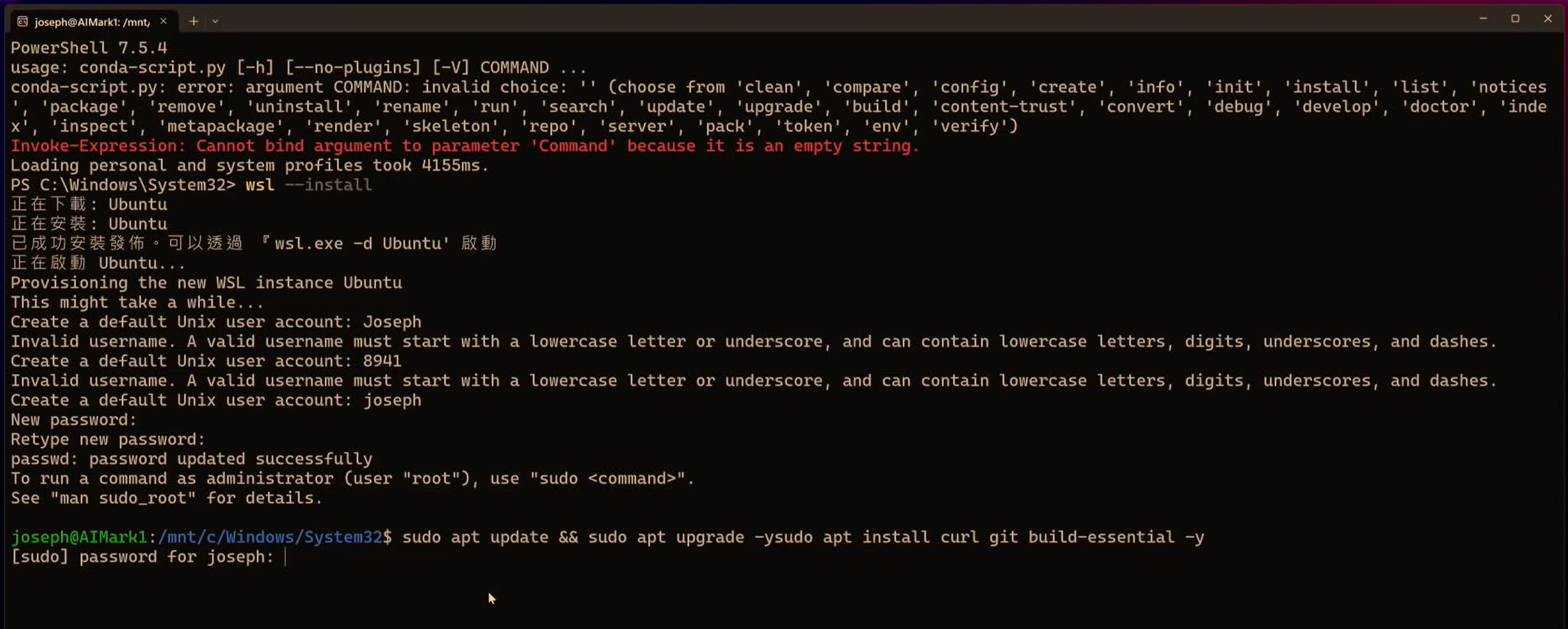

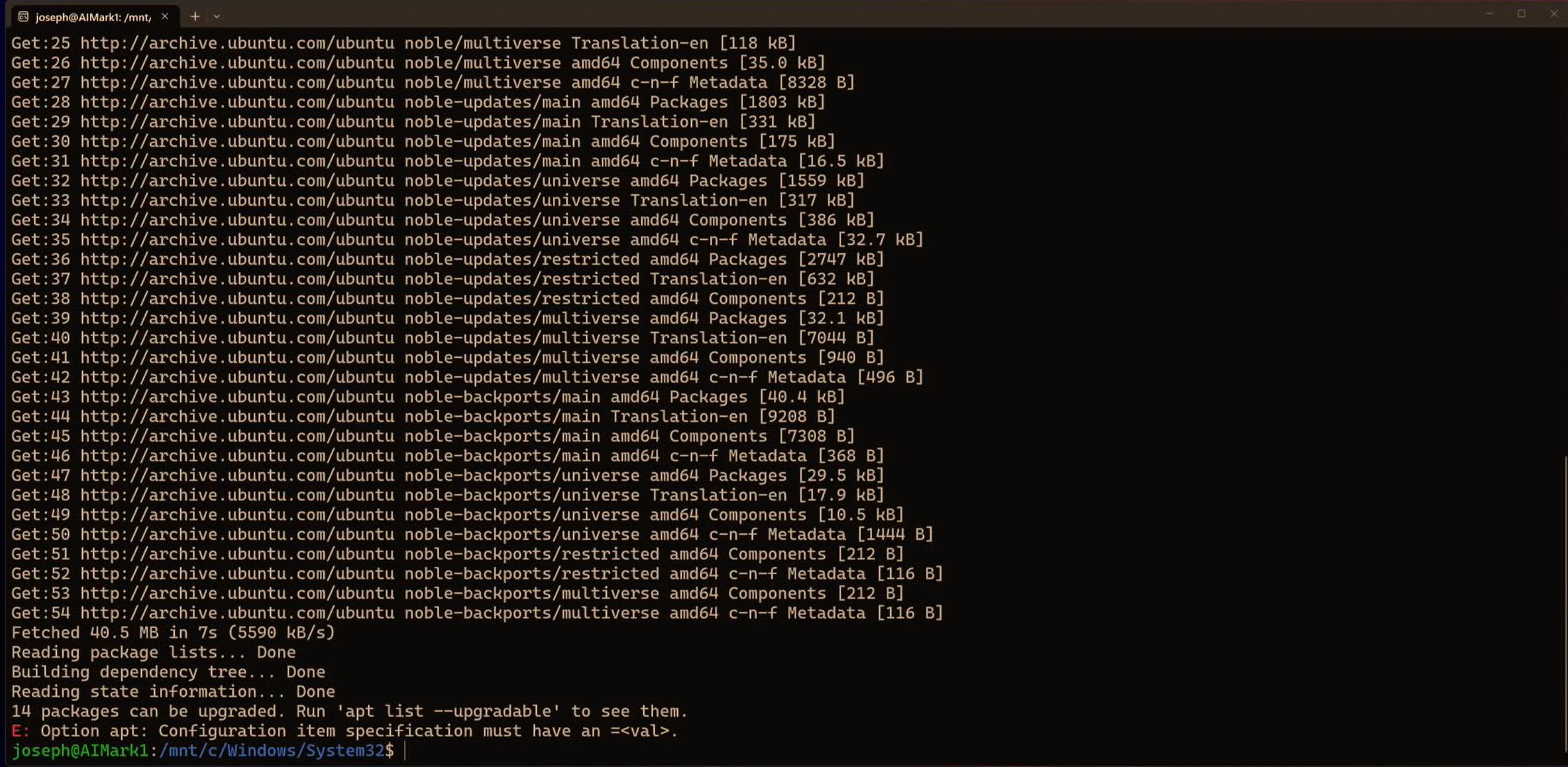

Step 1:安裝 WSL

用系統管理員身份開啟 PowerShell(在開始選單搜尋 PowerShell,右鍵「以系統管理員身份執行」):

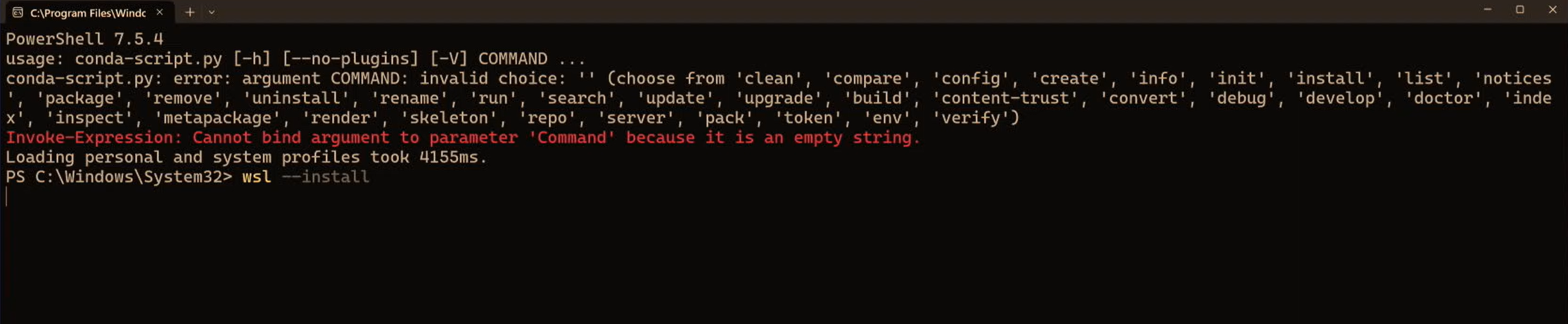

輸入安裝指令:

wsl --install

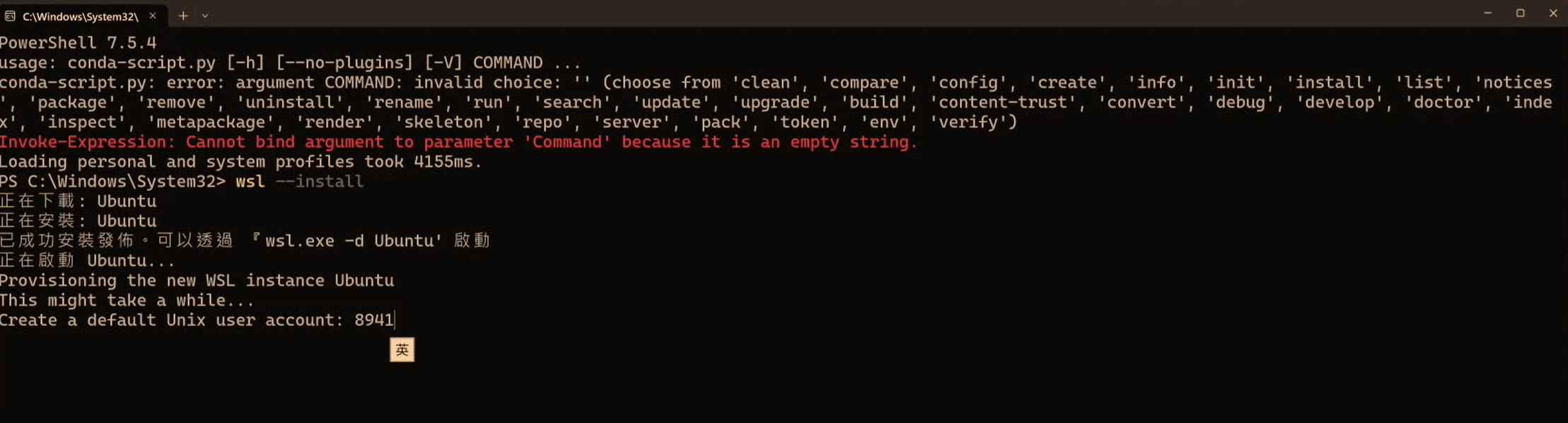

安裝完成後,重新開機。

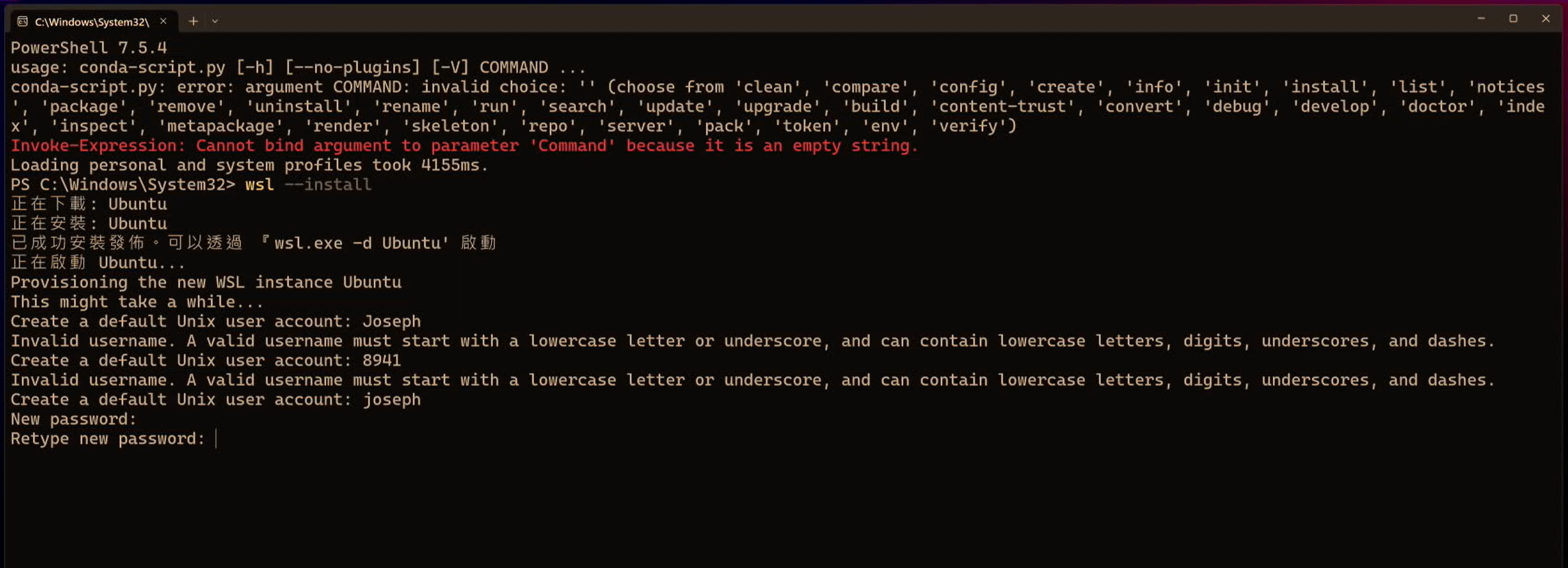

重開機後,WSL 會自動繼續安裝 Ubuntu,過程中會要求設定 Linux 使用者名稱和密碼(這組帳密只用在 WSL 內部,隨便設一組就好,但要記住):

🚨 如果 wsl —install 沒反應,可能需要先在 BIOS 開啟虛擬化(Virtualization)功能。詳細步驟見 Windows WSL 安裝指南。

確認 WSL 安裝成功:

wsl --versionStep 2:在 WSL 安裝 Node.js 22

務必安裝 Node 22,版本過舊會導致 OpenClaw 無法正常運作。

在 WSL 終端機(Ubuntu)中執行,先安裝 nvm(Node 版本管理工具):

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.1/install.sh | bash

安裝完後,關閉終端機再重開(讓 nvm 生效),然後安裝 Node 22:

nvm install 22

nvm use 22

nvm alias default 22

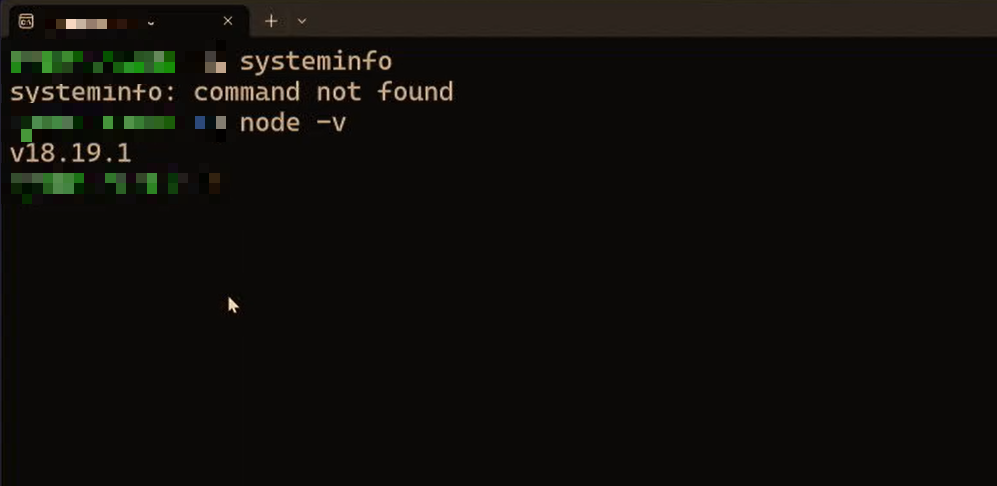

確認版本正確,必須是 v22.x.x:

node --version

🚨 如果顯示舊版本,執行

nvm use 22再確認一次。若 nvm 指令找不到,關閉終端機重開再試。

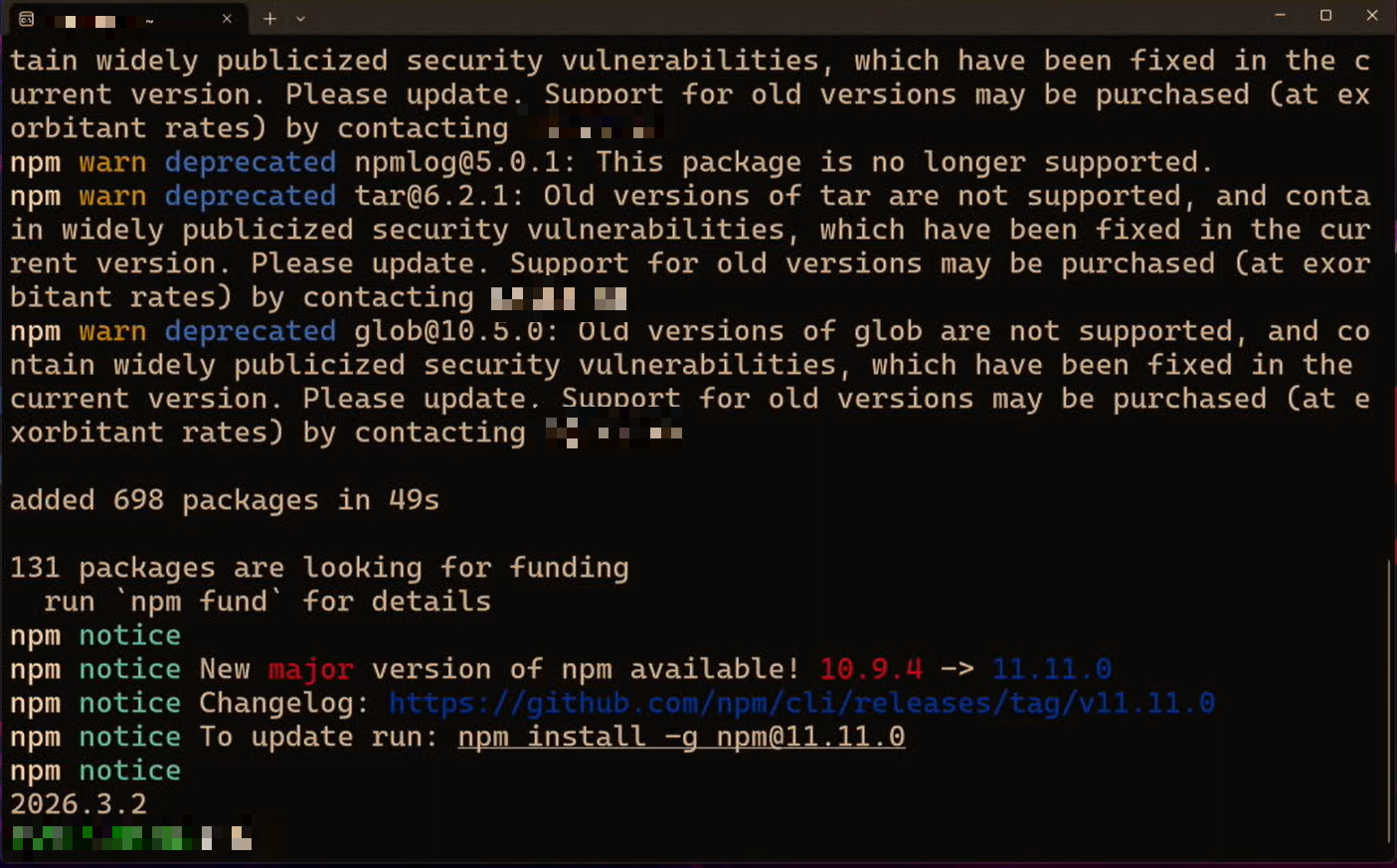

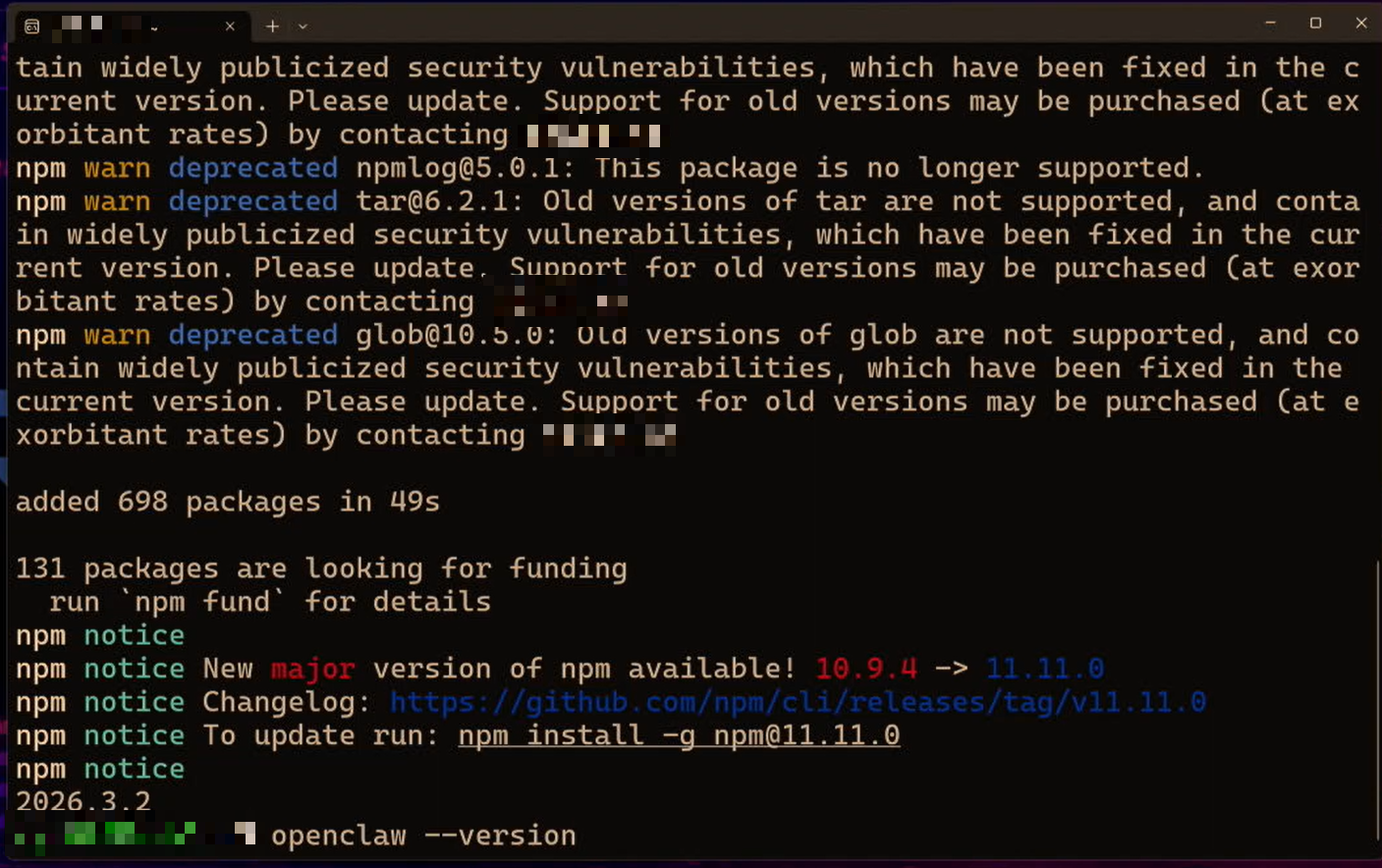

Step 3:安裝 OpenClaw

在 WSL 終端機中執行:

npm install -g openclaw

安裝完成後驗證:

openclaw --version

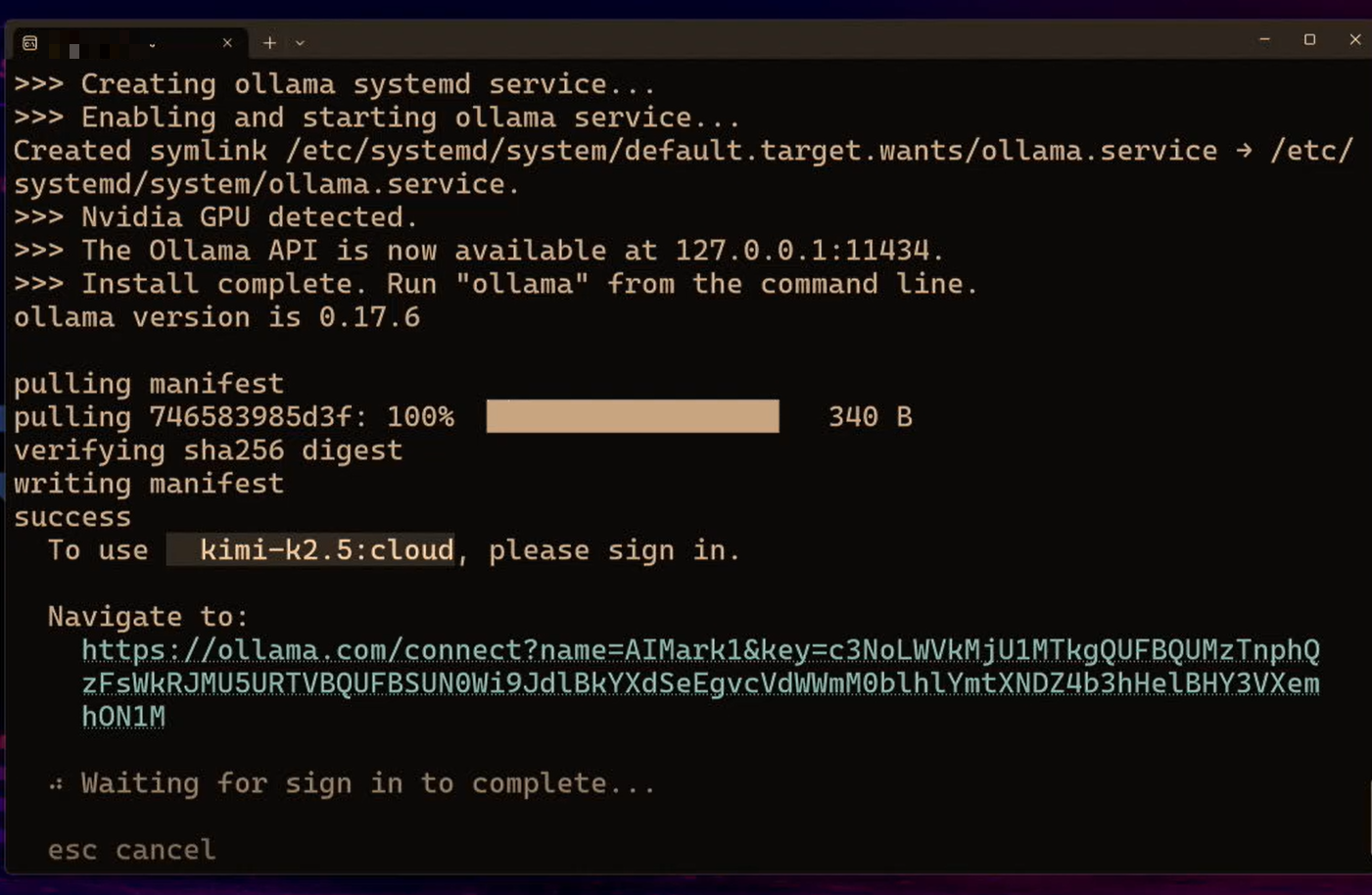

Step 4:在 WSL 安裝 Ollama

直接在 WSL 終端機中執行一鍵安裝腳本:

curl -fsSL https://ollama.com/install.sh | sh安裝完成後確認版本:

ollama --version確認 Ollama 服務正在執行(安裝後會自動啟動):

curl http://localhost:11434/api/tags看到 JSON 回應就代表 Ollama 已正常運行。

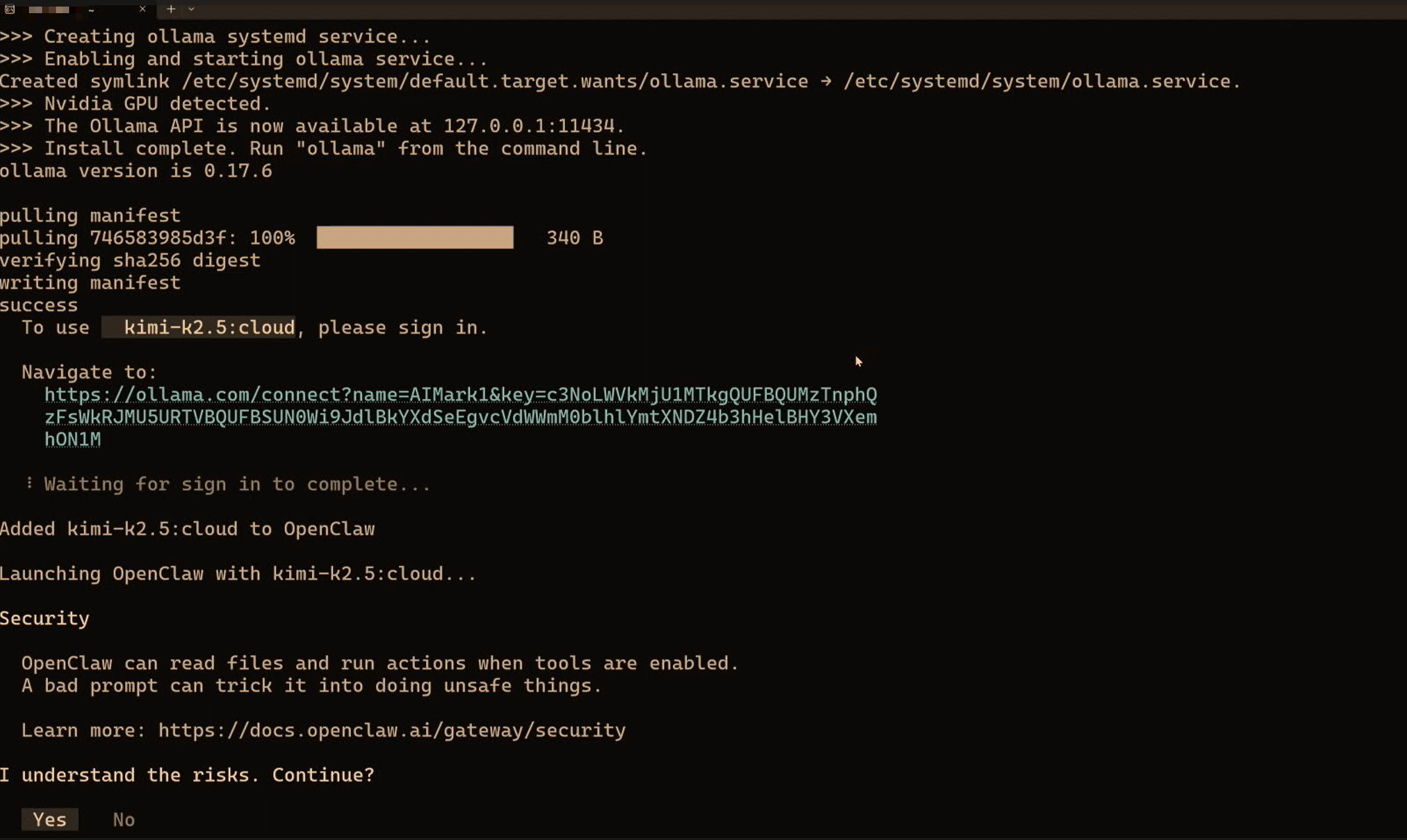

Step 5:執行 ollama launch openclaw

在 WSL 終端機中輸入:

ollama launch openclaw

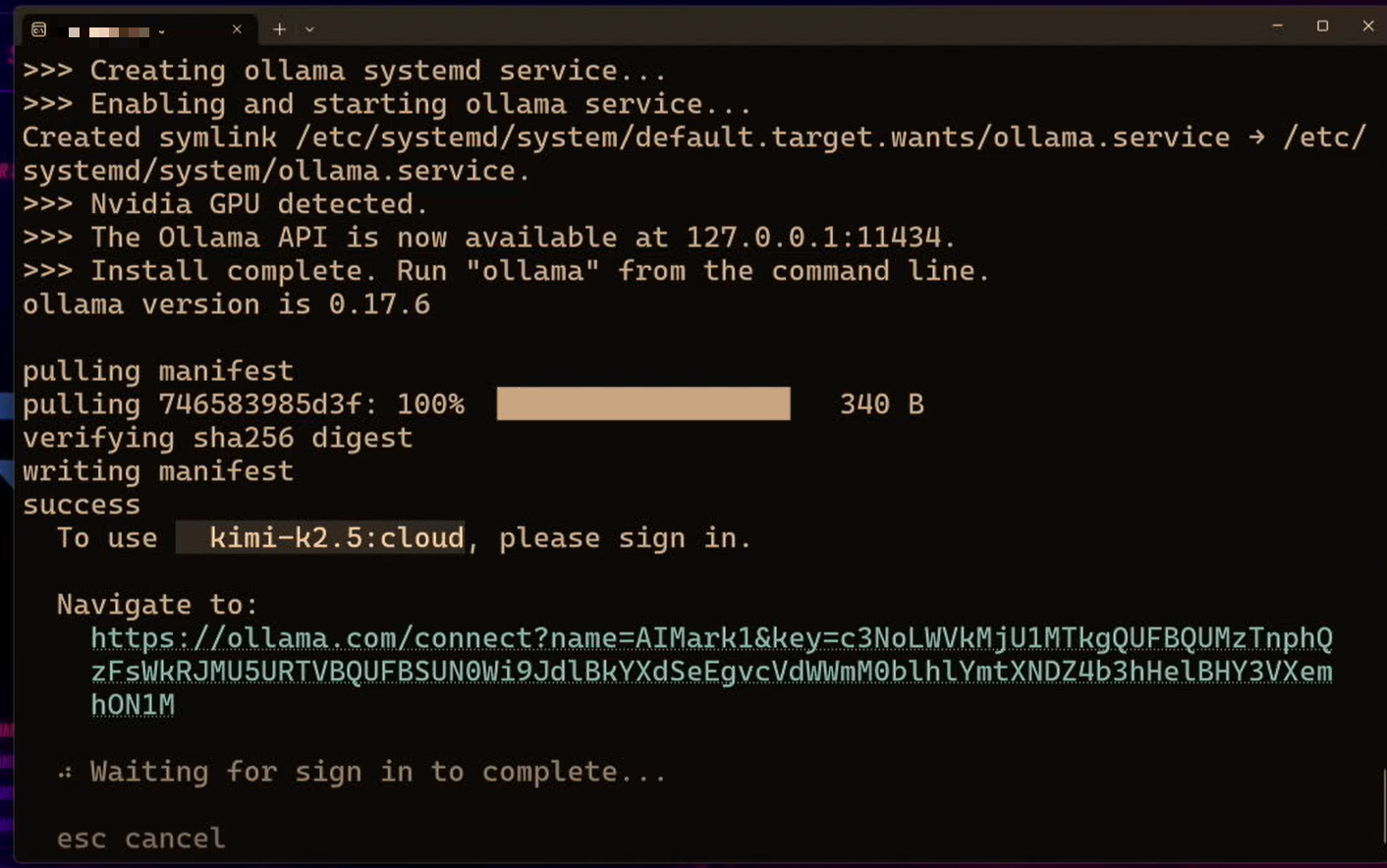

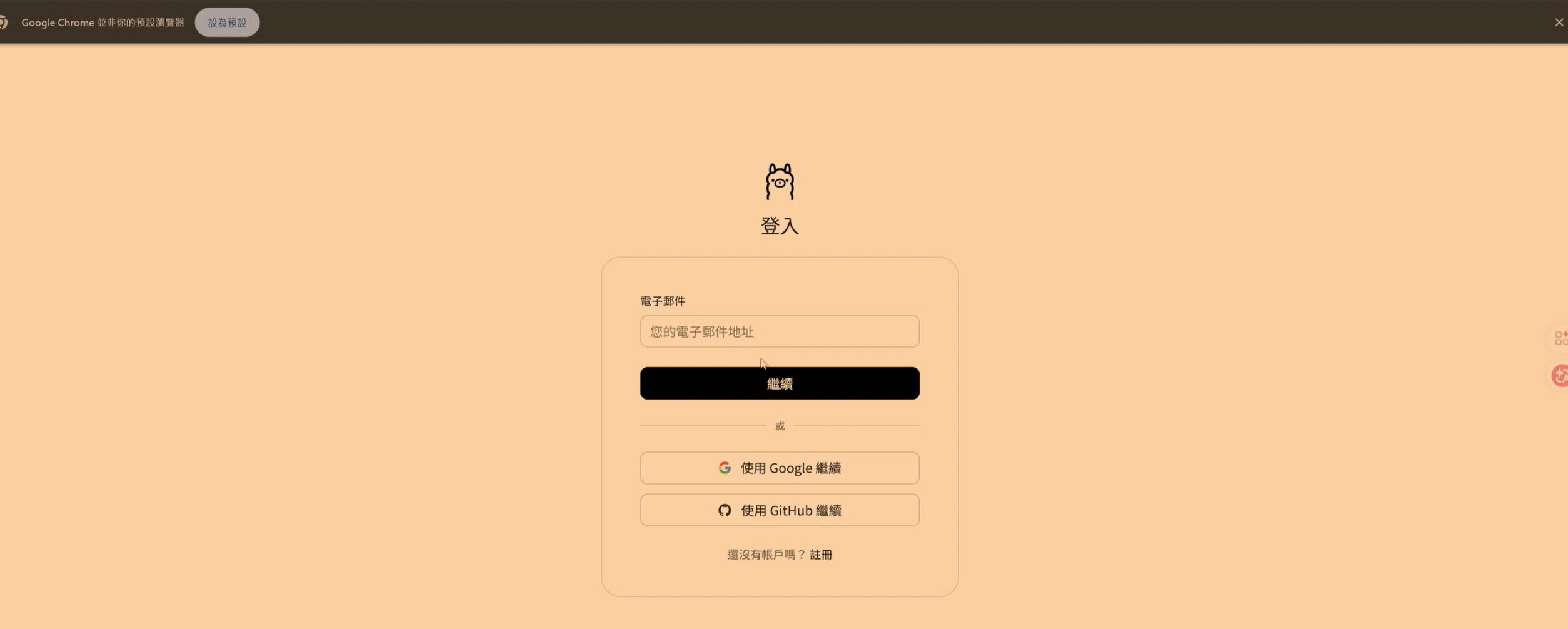

Step 6:登入 Ollama 帳號認證

第一次執行會要求登入 Ollama 帳號以使用免費雲端額度,畫面會顯示驗證連結或 QR code:

- 複製終端機顯示的網址,貼到 Windows 瀏覽器開啟(或掃描 QR code)

- 用 Google 帳號登入 Ollama

回到終端機,認證完成後會繼續啟動流程。

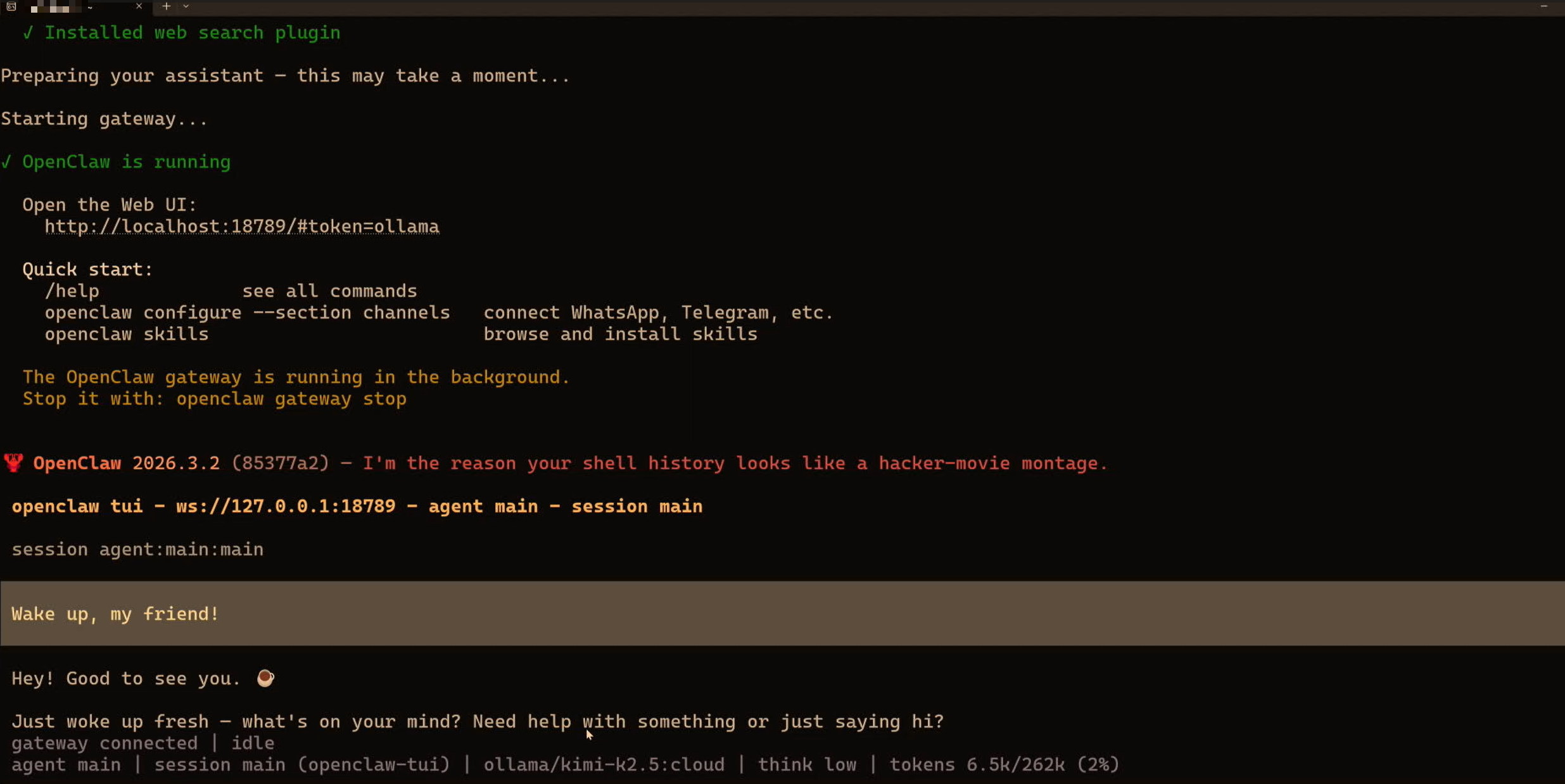

Step 7:選擇模型,開始對話

出現模型選單後,選「Cloud」,使用 Ollama 免費雲端模型,不需下載到本機:

推薦的雲端模型:

模型 特色 minimax-m2.5🥇 實測推薦:工具呼叫能力最佳,Agent 任務表現優異 kimi-k2.51T 參數,對話品質強 glm-4.7通用型,穩定可靠 注意:以上模型試玩沒問題,但若要正式導入工作流程,建議換用 Claude、GPT-4o 等主流模型,穩定性與工具使用可靠度仍有明顯差距。

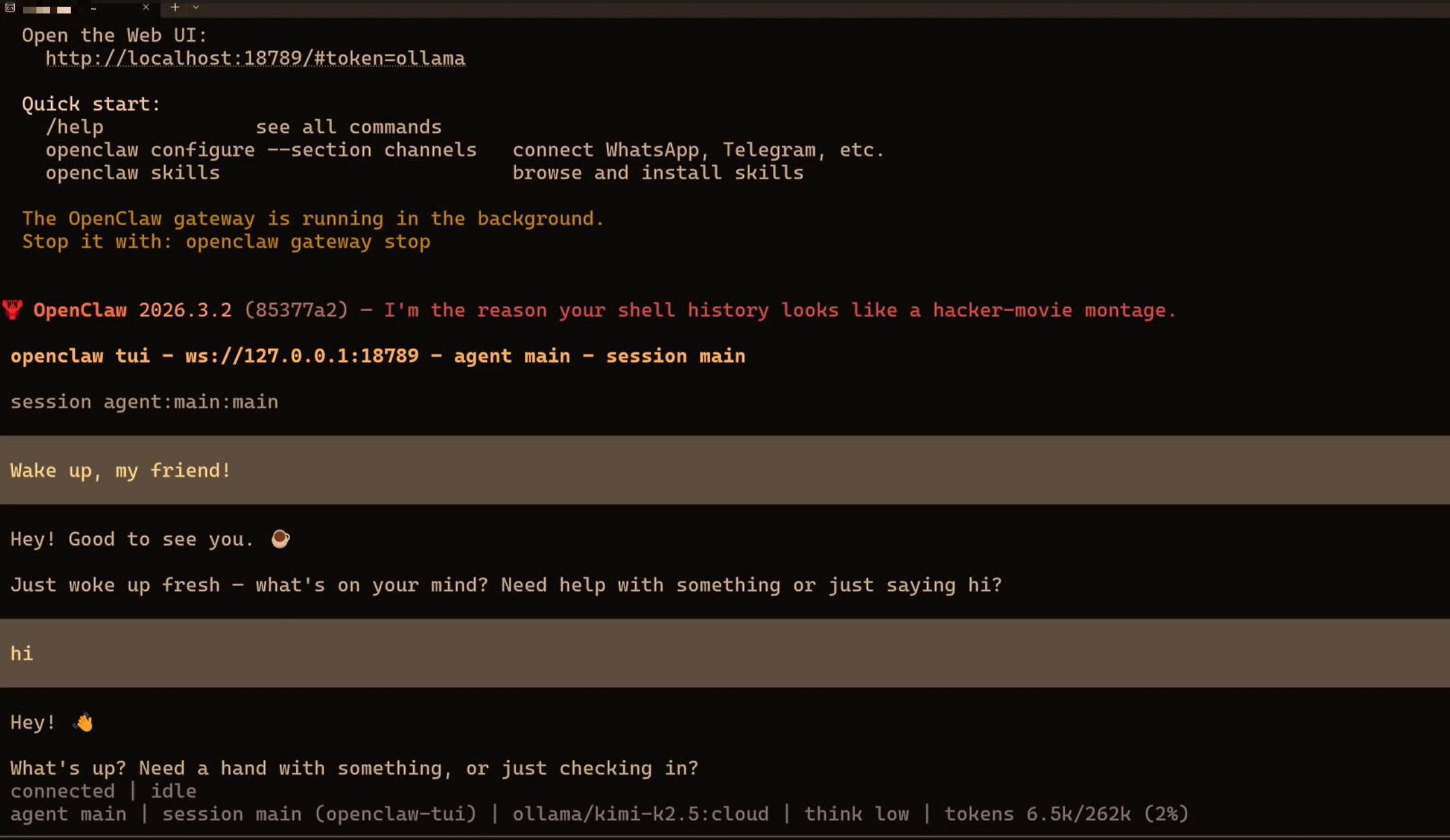

出現就緒畫面,代表成功啟動!

試著輸入:

你好!我是這裡的主人。請用繁體中文自我介紹——你是誰、你能做什麼。

另外,幫你自己取一個有特色的中文名字吧!

恭喜 🎉 你的龍蝦在 Windows 上正式啟動!

常見問題

🚨 curl Ollama 沒有回應

Ollama 服務可能尚未啟動,手動啟動它:

ollama serve &再重新執行 curl http://localhost:11434/api/tags 確認。

🚨 nvm 指令不存在

# 重新載入 shell 設定

source ~/.bashrc

# 或

source ~/.zshrc🚨 npm install 出現 Permission denied

不要用 sudo npm install -g,改用 nvm 安裝的 Node 就不會有權限問題。

🚨 模型回應是英文

直接告訴它:「請用繁體中文回覆」,它就會切換語言。

免費額度說明

Ollama 雲端模型有免費額度(官方說明):

- 前往 ollama.com/settings,用 Google 帳號登入

- 即可查看剩餘免費額度與用量

額度用完?可改用 Gemini Flash 雲端 API。

下一步

- ⚙️ 模型設定與切換

- 🧩 打造你的第一個 Skill

- 📱 串接 Telegram

有問題?到 首頁討論區 一起討論!

這篇文章對你有幫助嗎?

💬 問答區

卡關了?直接在這裡問,其他讀者和作者都能幫忙解答。

載入中...